Inviato da PNY Pro, 03 maggio 2019

Come appassionato di PC mi piace che le soluzioni hardware vengano analizzate in modo approfondito, per migliorare la loro efficienza relativa rispetto all'utilizzo di un'apparecchiatura migliore. Questo processo è noto anche come "Benchmarking". I risultati del benchmarking vengono considerati in questo ambito come il miglior strumento per la valutazione dei risultati dei sistemi di produzione di energia elettrica nel momento in cui vengono acquistati.

In questa serie di blog discutiamo di come si costruisce un sistema, con l'obiettivo di effettuare un benchmarking delle soluzioni di GPU-Leistung per il Deep Learning con Ubuntu 18.04, NVIDIA GPU Cloud (NGC) e TensorFlow.

La serie di blog è stata modificata come segue:

Primo capitolo: Introduzione

Secondo capitolo: Analisi dell'hardware

Dritter Teil: Installazione del software

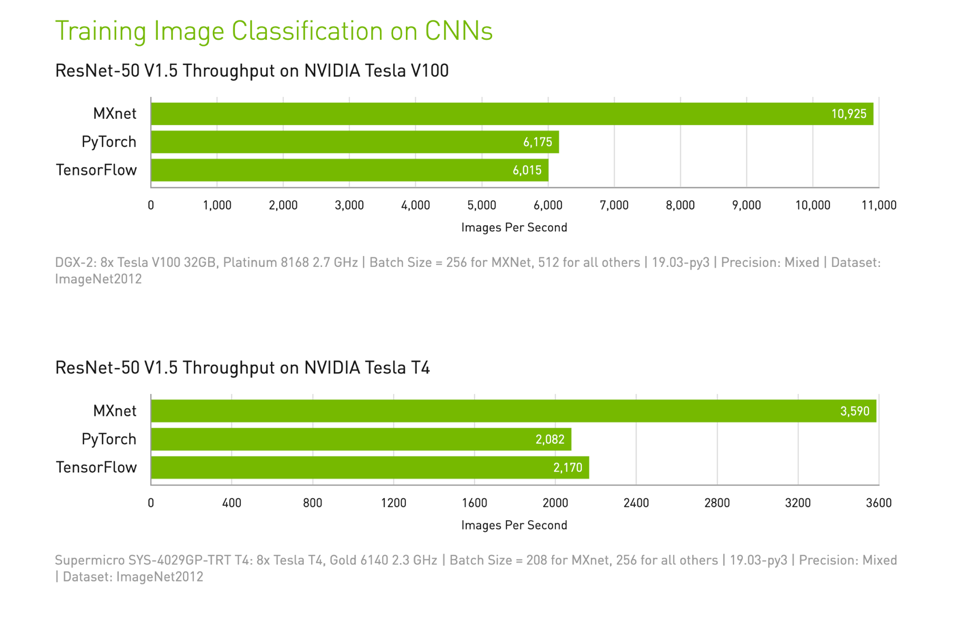

La maggior parte dei giocatori si è affidata a strumenti di benchmarking come 3DMark e Unigene Superposition, mentre i professionisti si sono affidati a strumenti di qualità come SPECviewperf e PassMark. Se si tratta di benchmark per l'apprendimento profondo, il più importante è l'addestramento di una rete neuronale ResNet-50 con l'ausilio dei dati ImageNet, in particolare di ImageNet-2012 per la classificazione dei disegni.

Le aziende, che si basano sul Deep Learning, utilizzano molto questa tecnica per la valutazione e per la verifica della qualità del prodotto. Questa metrica è stata pubblicata in un blog di NVIDIA, in cui sono state presentate diverse strutture di Deep Learning. Qui potete trovare ulteriori informazioni: https://developer.nvidia.com/deep-learning-performance-training-inference

Da sich das Deep Learning rasch weiterentwickelt, ist diese Kennzahl keine vollständige Darstellung der Leistung des Deep Learning. È comunque utile e pertinente, in quanto offre uno standard equo per la comparazione dei risultati di "Bildern pro Sekunde".

Da sich das Deep Learning rasch weiterentwickelt, ist diese Kennzahl keine vollständige Darstellung der Leistung des Deep Learning. È comunque utile e pertinente, in quanto offre uno standard equo per la comparazione dei risultati di "Bildern pro Sekunde".

Vorrei far notare che il Dr. Kinghorn del partner PNY Puget Systems da oltre un anno si occupa di questo tema; i suoi blog sono un prezioso strumento per i principianti e offrono consigli utili anche ai clienti più esperti. Le sue raccomandazioni sono molto interessanti. Non perdete tempo e leggete il suo blog di 5 pagine.

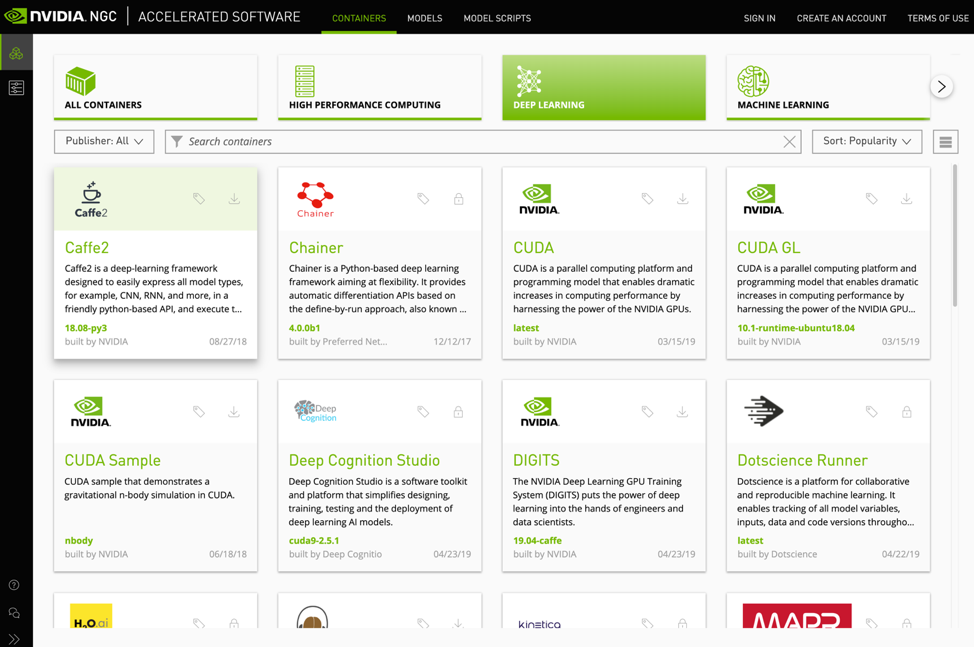

Einführung in NGC.

La Geheimwaffe per la realizzazione di questi benchmark di workflow è NVIDIA GPU-Cloud, o NGC.

NGC è un'applicazione Docker-Container-Registrierung a costo zero, una serie di software per l'analisi e l'apprendimento dei dati. Tra i framework più noti, che sono disponibili su NGC, ci sono TensorFlow, PyTorch, Caffe2 e molti altri. È possibile accedere al registro NGC tramite il seguente link: https://ngc.nvidia.com/catalog, una registrazione non è necessaria.

Che cos'è un contenitore? Laut Docker.com :

"Un container è una struttura standard di software, che contiene il codice e tutte le sue abilità, in modo che l'utilizzo avvenga in modo rapido e semplice da un computer all'altro. Ein Docker-Container-Image è un pacchetto software leggero, autonomo e ausführbares, che contiene tutto ciò che serve per l'utilizzo di un'applicazione: codice, durata, strumenti di sistema, biblioteche di sistema e installazioni ". https://www.docker.com/resources/what-container

In base a questa definizione, un container è un gruppo di software controllato, in cui il software complessivo è talmente controllato da essere ben integrato. Con l'utilizzo di Docker-Container si è sicuri che il proprio Software-Umgebung tra i vari test sia coerente e che le anomalie tra le varie biblioteche siano esenti da errori. Gli NGC-Container hanno il vantaggio di essere ottimizzati da NVIDIA, validati e resi compatibili con le GPU, in modo da poter lavorare al meglio con le GPU NVIDIA.

Perché si deve utilizzare un sistema Linux? In questo momento NGC funziona solo con Linux.

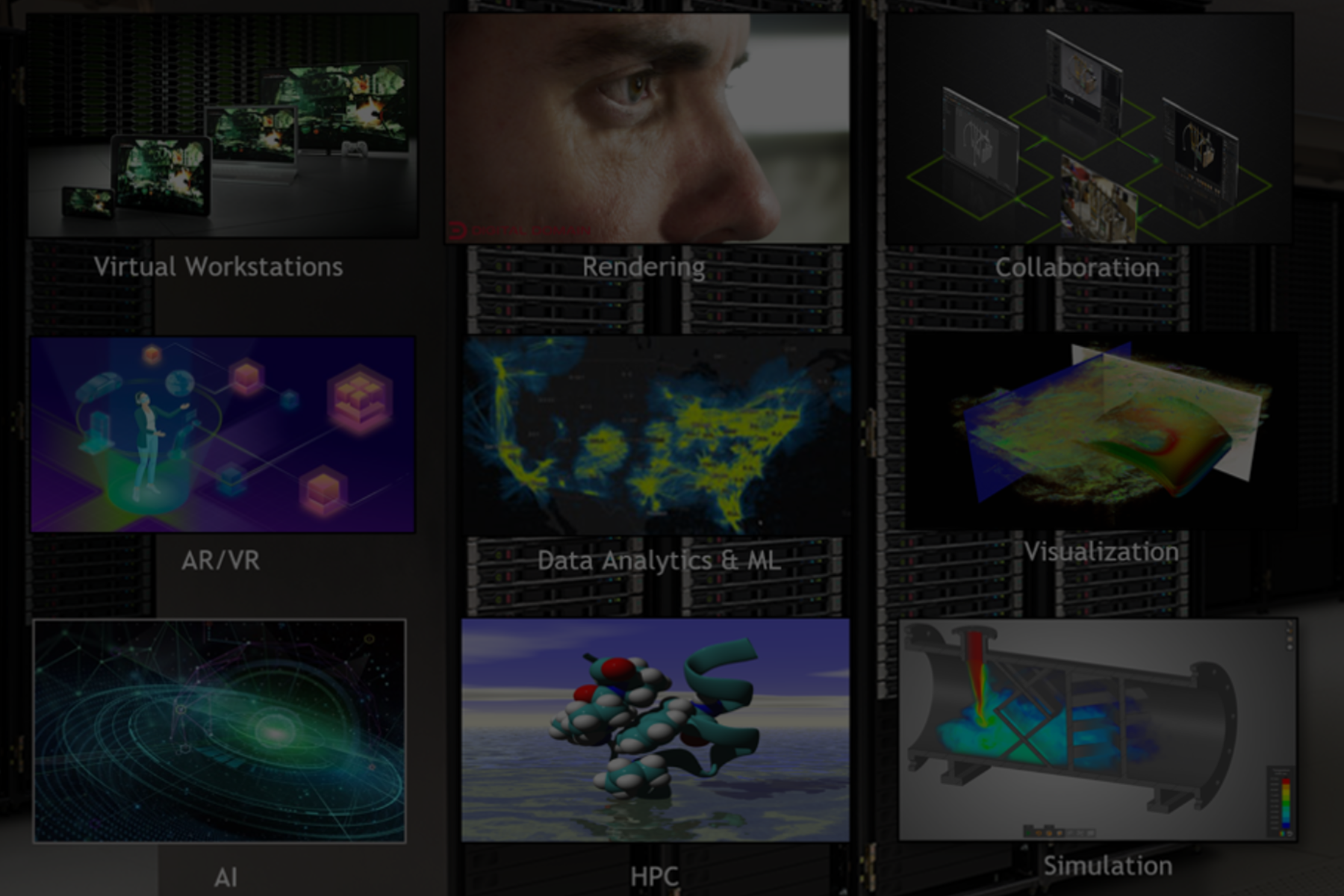

Dopo averci rassicurato con le nostre ultime notizie sull'hardware, vi invitiamo a visitare il registro NGC per avere un'idea dei diversi contenitori disponibili. Visitate anche la PNY-Landingpage per ottenere informazioni di carattere tecnico, in modo da ottenere ulteriori informazioni su come le GPU NVIDIA possano conquistare il mondo.